AI-Forordningen

Hva er AI-forordningen

EUs kommende «Artificial Intelligence Act», også kalt «AI Act» (heretter «AI-forordningen») er EUs forsøk på et spesifikt rettslig rammeverk for å regulere visse aspekter av AI.

Forordningen tar sikte på å regulere bruk av AI-systemer på en sektoruavhengig og mest mulig teknologinøytral måte. Forordningen er på mange måter bygget etter modell av produktsikkerhetslovgivningen i EU, og målet er å sikre at utviklingen og bruken av AI-systemer er ansvarlig og i tråd med grunnleggende rettigheter, samt å sikre fri flyt av AI-baserte varer og tjenester innen EU.

Et nærmere sammendrag av AI-forordningen finnes her.

Status for AI-forordningen

Etter en uvanlig lang og omdiskutert prosess foreligger det nå utkast til en endelig tekst for AI-forordningen. Denne vil antakeligvis bli vedtatt i løpet av våren 2024, og vil antakelig tre i kraft trinnvis i løpet av en periode på tre år fra vedtakelsen. Som forordning vil den da også gjelde direkte i alle EU-land. AI-systemer med uakseptabel risiko antas å bli forbudt allerede seks måneder etter vedtakelsen, mens enkelte regler antas å tre i kraft så sent som 2030.

Det gjenstår også et stort arbeid innenfor EU med å ferdigstille tekniske standarder og andre forskrifter på lavere nivå. Mange av bestemmelsene i AI-Forordningen lener seg i praksis på disse, basert på en forutsetning om at disse eksisterer. Det er derfor også mange detaljer som vil være uavklart inntil videre.

Det er lite som tyder på at AI-forordningen ikke vil bli inntatt i EØS-avtalen, og vi må derfor regne med at den vil gjelde også i Norge. Norske myndigheter vil formodentlig ha som ambisjon å gjennomføre AI-forordningen etter samme tidslinje som EU, men EØS-prosessen skaper nok en reell risiko for forsinkelser. Særlig fremstår det som usikkert om EØS-prosessen og norsk lovgivningsprosess vil være ferdigstilt til de innledende trinnene for AI-forordningen trår i kraft i EU. Det er likevel ikke sikkert at en slik forsinkelse vil få særlig praktisk betydning, da mange virksomheter som omfattes av AI-forordningen nok også vil ha virksomhet i EU-land. Slikt sett vil nok mange norske virksomheter uansett måtte forholde seg indirekte til regelverket.

Definisjonen av AI-system

AI-forordningen definerer et AI-system som (vår oversettelse fra engelsk):

et maskinbasert system designet for å fungere med varierende nivåer av autonomi og som kan vise tilpasningsevne etter idriftsettelsen og som, for eksplisitte eller implisitte mål, utleder, fra inndata som den mottar, hvordan utdata genereres i form av eksempelvis prediksjoner, innhold, anbefalinger, eller beslutninger som kan påvirke fysiske eller virtuelle miljøer.

Definisjonen er ment å omfatte en rekke ulike typer AI-systemer og teknologier, både nå og i fremtiden, og er også forutsatt harmonisert med internasjonalt anerkjente definisjoner av AI. I fortalen understrekes blant annet er systemets mulighet for å fungere autonomt, og til å utlede nytt innhold, som karakteriserer et AI-system og skiller det fra tradisjonell programvare. Samtidig understrekes det at systemer som utelukkende er basert på regler (algoritmer) som er definert av mennesker ikke skal omfattes av definisjonen. Man tenker altså først og fremst systemer som baserer seg på maskinlæring eller nevrale nettverk mv, og hvor det kan være vanskelig for mennesker å forstå akkurat hvordan systemet fungerer.

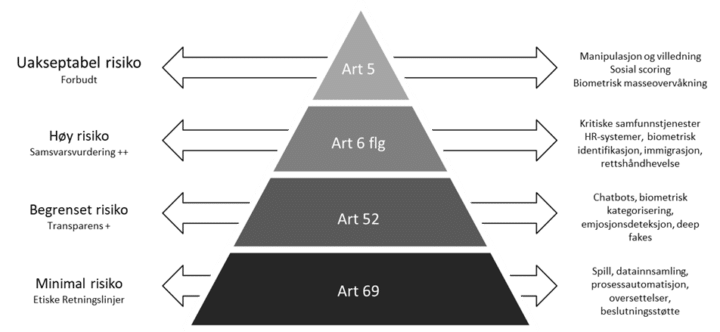

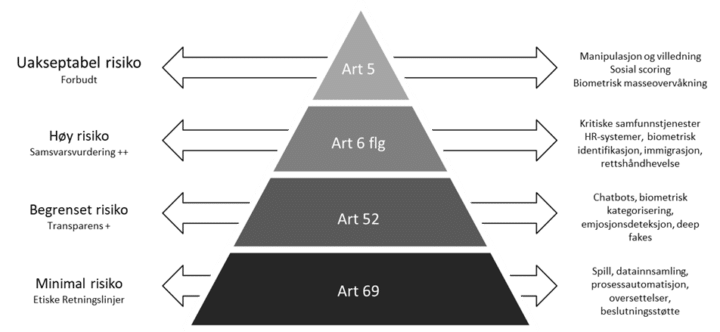

Risikobasert tilnærming

AI-forordningen legger opp til en risikobasert tilnærming til regulering av AI, der man opererer med ulike risikokategorier for AI, og hvor høyere risikokategori betyr strengere regulering.

AI-systemer som strider med grunnleggende verdier anses å innebære uakseptabel risiko, og vil generelt bli forbudt.

AI-systemer med høy risiko vil underlegges krav for etisk bruk av AI, som blant annet omfatter krav om menneskelig tilsyn, krav til teknisk robusthet og sikkerhet, personvern og datakontroll, transparens, ikke-diskriminering og rettferdighet, bærekraft og ansvarliggjøring.

AI-systemer med lav risiko bare medføre begrensede plikter etter forordningen.

De fleste AI-systemer for bruk i ordinære virksomheter antas å ville klassifiseres som lav risiko i denne sammenheng, samtidig kan bruk av AI-systemer i enkelte typer virksomheter som er kritiske for samfunnet i seg selv gjøre at AI-systemet anses som høy risiko for dette formålet.

Det er også verdt å merke seg at AI-forordningen først og fremst måler risiko opp mot grunnleggende rettigheter (menneskerettigheter), og ikke kommersiell, teknisk eller juridisk risiko. AI-forordningens risikoklassifisering må derfor ikke forstås som noen målestokk for hvilken risiko bruken av et AI-system medfører for den enkelte virksomhet.

Betydning

AI-forordningen innebærer for det første en fullharmonisert tilnærming til AI-regulering innen EU, og vil derfor også begrense lovgivernes muligheter for å regulere AI-systemer på en annen måte enn det som følger av AI-forordningen.

AI-forordningen medfører først og fremst plikter for tilbydere av AI-systemer, og den har størst fokus på AI-systemer som innebærer høy risiko for grunnleggende rettigheter. Tilbydere av slike AI-systemer vil blant annet bli pålagt plikt til samsvarsvurdering og registrering.

Det stilles også særskilte krav til såkalte grunnmodeller og generelle AI-systemer (såkalt GPAI), inkludert generativ AI. AI-forordningen har her også regler om hvordan det regulatoriske ansvaret stiller seg der man integrerer GPAI-systemer i annen programvare mv. Virksomheter som integrerer GPAI-modeller i egne løsninger må derfor være oppmerksom på dette.

Virksomheter som bare benytter et AI-systemer i egen virksomhet, uten selv å være tilbydere, pålegges imidlertid kun begrensede direkte plikter under AI-forordningen, og da også begrenset til AI-systemer med høy risiko. Bruk av høyrisiko AI vil blant annet stille krav til risikovurderinger og menneskelig tilsyn, og dette vil kreve tilstrekkelige ressurser og kompetanse for de virksomheter som dette gjelder.

AI-forordningens fokus på tilbydere og høyrisikosystemer gjør også at den antakeligvis vil ha mindre direkte betydning for vanlige virksomheter enn eksempelvis innføringen av GDPR hadde. Det er imidlertid verdt å merke seg at bruken av AI-systemer kan ha betydning for hvilke plikter man har under andre regelsett. Blant annet stiller GDPR særskilte krav til behandling av personopplysninger ved bruk av AI.

Man bør uansett være bevisst på hvilken risikoklassifisering de AI-systemer virksomheten tilbyr eller benytter har eller vil få etter AI-forordningen. Virksomheter innen kritiske samfunnsområder, slik som transport, helse, energi, finans, telekommunikasjon mv, må også være oppmerksom på at bruk av AI innen deres områder ofte vil klassifiseres med høy risiko.

Tilsyn og sanksjoner

Det legges opp til et styringsregime med tilsynsmyndigheter og markedsovervåkning både på europeisk og nasjonalt nivå, samt sertifiseringsmekanismer mv. Overtredelser av AI-forordningen kan straffes med bøter inntil 7% av årlig omsetning på verdensbasis, eller EUR 40 millioner dersom dette er høyere. Erfaringene med GDPR tyder på at sanksjonsregimet vil kunne benyttes til det fulle overfor virksomheter som ikke følger reglene.